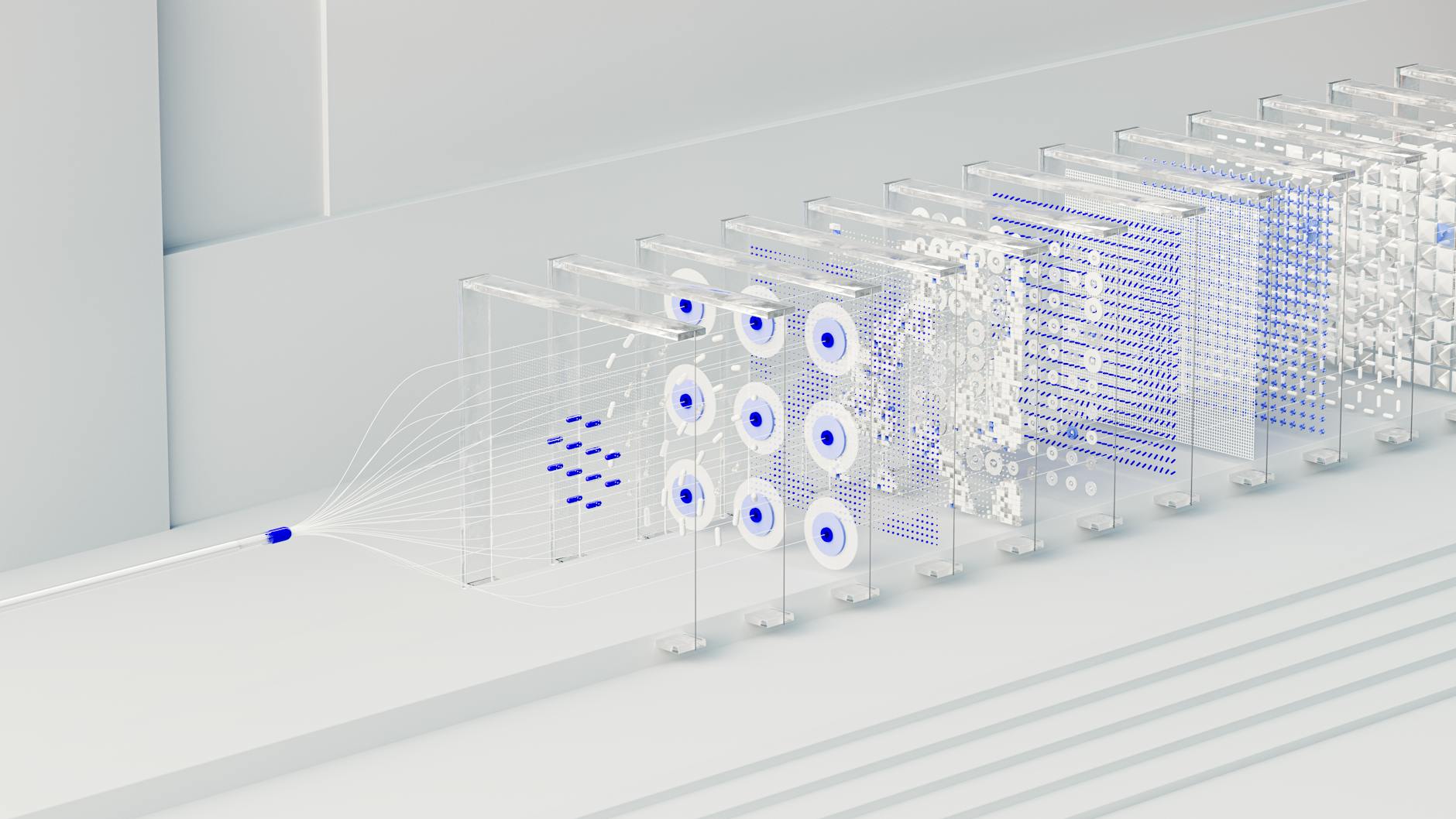

Wer KI nutzen möchte, ohne Daten in fremde Clouds zu schicken, braucht ein Local LLM Setup im eigenen Homelab. In diesem Guide erfährst du, welche Hardware du brauchst, welche Software sich bewährt hat und wie du in wenigen Schritten deinen eigenen KI-Assistenten unter Vollkontrolle betreibst — offline, ohne Abonnement, ohne Datenweitergabe.

Warum ein Local LLM Setup 2026 sinnvoll ist

Die Nachfrage nach self-hosted AI ist in den letzten Jahren stark gestiegen. Cloud-Dienste wie ChatGPT oder Claude sind leistungsstark, aber mit Kosten und Datenschutzrisiken verbunden. Ein lokales Setup gibt dir:

- Datenschutz: Kein Datentransfer zu Drittanbietern

- Kostenersparnis: Einmalige Hardware-Investition statt monatlicher Abos

- Offline-Fähigkeit: Kein Internet nötig

- Anpassbarkeit: Modelle individuell konfigurierbar

Große Modelle werden 2026 effizienter und laufen auf Consumer-Hardware, die früher nicht ausreichte. Die Open-Source-Community treibt diese Entwicklung mit Modellen wie Llama, Mistral oder Qwen rasant voran.

Hardware-Anforderungen für dein Local LLM Setup

GPU: Das Herzstück

| Hardware | VRAM | Geeignet für |

|---|---|---|

| RTX 4090 | 24 GB | Modelle bis 70B (4-Bit) |

| RTX 3090 / 3080 Ti | 24 / 12 GB | Modelle bis 30B |

| NVIDIA A6000 (gebraucht) | 48 GB | Große Modelle, Top-Preis-Leistung |

| AMD RX 7900 XTX | 24 GB | NVIDIA-Alternative mit ROCm |

Gebrauchte Enterprise-GPUs wie die A6000 oder A100 aus Rechenzentrumsbeständen sind auf dem Second-Hand-Markt oft das beste Preis-Leistungs-Verhältnis. Wer lieber schlüsselfertige Edge-KI-Hardware kauft: Das NVIDIA Jetson Orin Nano (Amazon-Partnerlink) bietet dedizierte GPU-Einheiten bei unter 15 Watt — ideal für stromsparenden Dauerbetrieb.

RAM

32 GB RAM reichen für Modelle bis 13B. Bei größeren Modellen oder Parallelbetrieb mehrerer Dienste sind 64 GB empfehlenswert. Der RAM ist beim Laden des Modells kritisch — während der GPU-VRAM die Berechnung übernimmt.

CPU, Storage und Stromverbrauch

Aktuelle Intel i7/i9 oder AMD Ryzen 7/9 mit ausreichend PCIe-Lanes. Schnelle NVMe-SSDs sind Pflicht — Modelle mit 30–70 GB Größe brauchen Ladebandbreite. Für die Modell-Storage empfiehlt sich eine schnelle 1TB-SSD, z. B. die Samsung 870 EVO 1TB (Amazon-Partnerlink). Unter Volllast verbraucht ein KI-Server 300–500 Watt, das sollte in die Betriebskostenkalkulation einfließen.

Die beste Software für dein Local LLM Setup

Ollama: Einstieg für Anfänger

Ollama ist der einfachste Weg, lokale LLMs zu betreiben. Als dedizierter Ollama-Server eignet sich z. B. der Beelink Mini S12 Pro (N100) (Amazon-Partnerlink) — kompakt, lautlos und dauerhaft in Betrieb zu halten. Ein Befehl installiert, ein Befehl startet:

curl -fsSL https://ollama.com/install.sh | sh

ollama run llama3.2

Ollama bietet eine REST-API, läuft auf Linux, macOS und Windows und hat eine breite Modell-Bibliothek. Ideal als Backend für Open WebUI.

llama.cpp: Maximale Performance

Wer das letzte bisschen aus seiner Hardware herausholen will, greift zu llama.cpp. Das C++-Framework bietet die beste Inference-Performance auf Consumer-Hardware, unterstützt verschiedene Quantisierungsmethoden und lässt sich als API-Server betreiben — besonders interessant für Entwickler.

Open WebUI: Browser-Interface für deine Modelle

Open WebUI kombiniert sich ideal mit Ollama und bietet eine ChatGPT-ähnliche Oberfläche direkt im Browser:

- Mehrere Modelle parallel nutzbar

- Dokumenten-Upload für RAG

- Benutzerverwaltung für Team-Einsatz

- Einfache Docker-Installation

KoboldCPP vs. Ollama vs. Text Generation WebUI

| Tool | Stärke | Zielgruppe |

|---|---|---|

| Ollama | Einfachheit, API | Einsteiger, Entwickler |

| llama.cpp | Maximale Performance | Power-User |

| Open WebUI | Browser-Interface | Alle |

| KoboldCPP | Storytelling, Rollenspiel | Kreativnutzer |

| Text Generation WebUI | Maximale Kontrolle | Fortgeschrittene |

Schritt-für-Schritt: Local LLM Setup mit Ollama und Open WebUI

Schritt 1: System vorbereiten

sudo apt update && sudo apt upgrade -y

sudo apt install -y curl docker.io docker-compose

Für NVIDIA-GPUs: aktuelle Treiber und CUDA-Toolkit installieren. AMD-Nutzer brauchen die ROCm-Treiber.

Schritt 2: Ollama installieren

curl -fsSL https://ollama.com/install.sh | sh

Schritt 3: Open WebUI per Docker Compose starten

version: '3.8'

services:

ollama:

image: ollama/ollama:latest

container_name: ollama

volumes:

- ./ollama:/root/.ollama

ports:

- "11434:11434"

deploy:

resources:

reservations:

devices:

- driver: nvidia

count: 1

capabilities: [gpu]

open-webui:

image: ghcr.io/open-webui/open-webui:main

container_name: open-webui

ports:

- "3000:8080"

environment:

- OLLAMA_BASE_URL=http://ollama:11434

volumes:

- ./open-webui:/app/backend/data

depends_on:

- ollama

docker-compose up -d

Open WebUI ist anschließend unter http://deine-ip:3000 erreichbar.

Schritt 4: Modelle herunterladen

ollama pull llama3.2 # Allzweck

ollama pull codellama:34b # Coding

ollama pull mixtral:8x7b # Mehrsprachig

Anwendungsfälle für deinen privaten KI-Assistenten

Self-Hosted Coding Assistant

CodeLlama oder DeepSeek-Coder laufen lokal und analysieren Quellcode, ohne dass er das eigene Netzwerk verlässt. Integration in VS Code via Continue-Extension ist nahtlos. Ideal für Freelancer und Unternehmen mit IP-Schutzbedarf.

Lokales RAG-System

Mit einem Local RAG Setup beziehst du eigene Dokumente in KI-Gespräche ein. Open WebUI bringt diese Funktion mit — PDFs oder Textdateien hochladen, das Modell antwortet basierend auf diesen Inhalten. Anwendungsfälle: Vertragsanalyse, interne Wissensdatenbanken, vertrauliche Recherchen.

Lokale ChatGPT-Alternative für den Alltag

Llama 3.2 oder Mistral beherrschen Deutsch, fassen Texte zusammen, formulieren E-Mails und helfen bei Recherchen — komplett offline und ohne Datenweitergabe.

Sicherheit: Zugriff absichern

Reverse Proxy mit SSL

Für externen Zugriff empfiehlt sich Traefik oder Nginx mit Let’s Encrypt:

labels:

- "traefik.enable=true"

- "traefik.http.routers.openwebui.rule=Host(`ai.deine-domain.de`)"

- "traefik.http.routers.openwebui.tls.certresolver=letsencrypt"

- "traefik.http.services.openwebui.loadbalancer.server.port=8080"

VPN für Fernzugriff

WireGuard ist die empfohlene Lösung: leichtgewichtig, schnell, einfach einzurichten. Der KI-Server bleibt hinter der Firewall, ist aber über den VPN-Tunnel von unterwegs erreichbar.

Authentifizierung

Benutzerverwaltung in Open WebUI aktivieren, starke Passwörter setzen, IP-Beschränkungen für sensible Instanzen konfigurieren.

Modellempfehlungen 2026

Einsteiger (7B–9B Parameter, ab 8 GB VRAM)

- Llama 3.2 8B — ausgewogen, schnell, gut auf Deutsch

- Mistral 7B — hervorragende Performance für die Größe

- Gemma 2 9B — gute deutsche Sprachunterstützung

Anspruchsvolle Aufgaben (30B–70B, 24+ GB VRAM)

- Llama 3.1 70B — State-of-the-Art Open Source

- Mixtral 8x7B — MoE-Architektur, effizient

- Qwen 2.5 72B — stark mehrsprachig, auch auf Deutsch

Spezialisiert

- CodeLlama 34B / DeepSeek-Coder 33B — Coding

- Neural Chat 7B — Konversation

Troubleshooting

Out of Memory: Niedrigere Quantisierung (Q4 statt Q8), CPU-Offloading aktivieren, Kontextlänge reduzieren.

Langsame Generierung: nvidia-smi prüfen, andere GPU-Prozesse beenden, Flash Attention aktivieren.

Open WebUI verbindet sich nicht:

systemctl status ollama

docker logs open-webui

OLLAMA_BASE_URL in der Docker-Compose kontrollieren.

FAQ: Local LLM Setup

Welche GPU brauche ich für ein Local LLM Setup? Für Einsteigermodelle (7B) reicht eine GPU mit 8 GB VRAM. Für Modelle bis 70B brauchst du mindestens 24 GB VRAM, z. B. RTX 4090 oder eine gebrauchte A6000.

Kann ich ein Local LLM ohne GPU betreiben? Ja, aber deutlich langsamer. llama.cpp unterstützt CPU-only-Betrieb. Für produktive Nutzung ist eine GPU jedoch empfehlenswert.

Welches Modell eignet sich als lokale ChatGPT-Alternative auf Deutsch? Llama 3.2 8B und Qwen 2.5 72B bieten die beste deutsche Sprachqualität. Für Einsteiger ist Llama 3.2 die einfachste Wahl.

Ist Ollama oder llama.cpp besser? Ollama ist einfacher zu bedienen und ideal für Einsteiger. llama.cpp bietet mehr Performance und Kontrolle für erfahrene Nutzer. Beides lässt sich kombinieren.

Was kostet ein Local LLM Setup im Betrieb? Hauptkosten sind Strom: 300–500 Watt unter Last. Bei 10 Stunden/Tag und 0,30 €/kWh ergibt das ca. 30–45 € im Monat — deutlich weniger als Cloud-Abos für intensive Nutzung.

Fazit

Ein Local LLM Setup ist 2026 für jeden Technik-Enthusiasten realistisch umsetzbar. Ollama und Open WebUI senken die Einstiegshürde auf ein Minimum, während llama.cpp für Power-User das Maximum aus der Hardware holt. Die Kombination aus Datenschutz, Kostenersparnis und Flexibilität macht self-hosted AI zur überzeugenden Alternative zu Cloud-Diensten.

Starte mit einem 7B-Modell auf vorhandener Hardware, taste dich vor und skaliere, wenn der Bedarf wächst. Die Grundlagen aus diesem Guide reichen, um heute loszulegen.